借助 NVIDIA A30 Tensor Core GPU 为各种企业工作负载带来加速性能。借助 NVIDIA Ampere 架构 Tensor Core 和多实例 GPU (MIG),它可以安全加速各种工作负载,其中包括大规模 AI 推理和高性能计算 (HPC) 应用程序。具有 PCIe 外形规格(非常适合主流服务器)的 A30 集快速显存带宽与低功耗于一体,不仅能实现弹性数据中心,还能为企业带来更大价值。

适用于主流企业服务器的多用途计算加速技术。

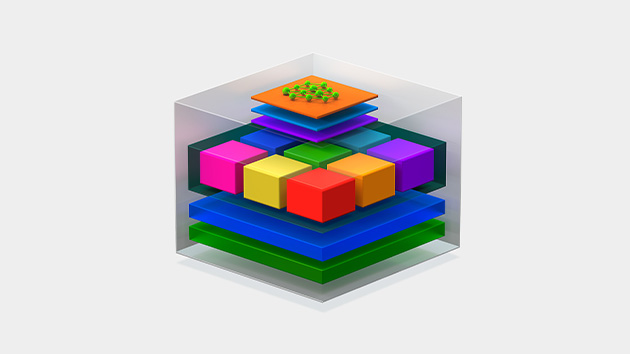

NVIDIA Ampere 架构是完整的 NVIDIA 企业数据中心解决方案的一部分,它囊括了硬件、网络、软件和库的构建模块,以及 NVIDIA NGC™ 目录中经优化的 AI 模型和应用程序。它为数据中心提供了强大的端到端 AI 和 HPC 平台,让研究人员能够快速交付真实的结果,并且大规模地将解决方案部署到生产环境中。

BERT Large 微调收敛训练

为应对对话式 AI 等新型挑战而训练 AI 模型需要强大的计算能力与可扩展性。

NVIDIA A30 Tensor Core 具备 Tensor Float (TF32) 精度,可提供比 NVIDIA T4 高 10 倍之多的性能,并且无需更改代码;若使用自动混合精度和 FP16,性能可进一步提升 2 倍,综合起来可将吞吐量提高 20 倍。与 NVIDIA® NVLink®、PCIe Gen4、NVIDIA Mellanox® 网络和 NVIDIA Magnum IO™ SDK 配合使用时,可以扩展到数千个 GPU。

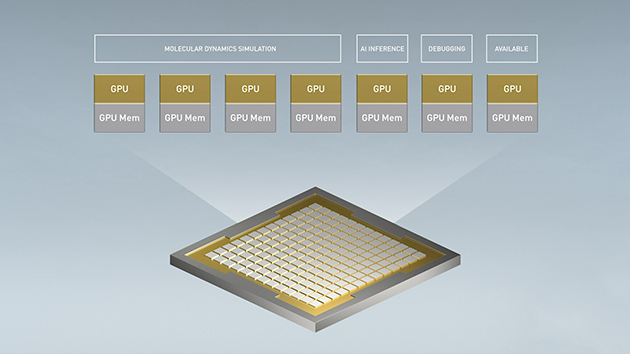

Tensor Core 和 MIG 使 A30 全天都能够动态地用于工作负载。它可以在需求高峰时段用于生产推理,并且部分 GPU 可以在非高峰时段改用于快速重新训练同一批模型。

NVIDIA 在行业级 AI 训练基准测试 MLPerf 中取得多项性能佳绩。

A30 引入了突破性的功能来优化推理工作负载。它能在从 FP64 到 TF32 和 INT4 的整个精度范围内进行加速。A30 每个 GPU 支持多达 4 个 MIG,允许多个网络在安全的硬件分区中同时运行,同时保证服务质量 (QoS)。在 A30 其他推理性能增益的基础之上,仅结构化稀疏支持一项就能带来高达两倍的性能提升。

NVIDIA 产品的出色 AI 性能在 MLPerf 推理测试中得到验证。通过与可以轻松地大规模部署 AI 的 NVIDIA Triton™ 推理服务器配合使用,A30 能为不同企业带来此突破性性能。

BERT Large 推理(标准化)

延迟小于 10 ms 的吞吐量

RN50 v1.5 推断(标准化)

延迟小于 7ms 的吞吐量

LAMMPS(标准化)

为了获得新一代的发现成果,科学家们希望通过模拟方式来更好地了解我们周围的世界。

NVIDIA A30 采用 FP64 NVIDIA Ampere 架构 Tensor Core,提供自 GPU 推出以来幅度非常大的 HPC 性能飞跃。配合 24 GB 的 GPU 显存和 933 GB/s 的带宽,可让研究人员快速解决双精度计算问题。HPC 应用程序还可以利用 TF32 提高单精度、密集矩阵乘法运算的吞吐量。

FP64 Tensor Core 与 MIG 的结合能让科研机构安全地对 GPU 进行分区,以允许多位研究人员访问计算资源,同时确保 QoS 和更高的 GPU 利用率。部署 AI 的企业可以在需求高峰时段使用 A30 的推理功能,然后在非高峰时段将同一批计算服务器改用于处理 HPC 和 AI 训练工作负载。

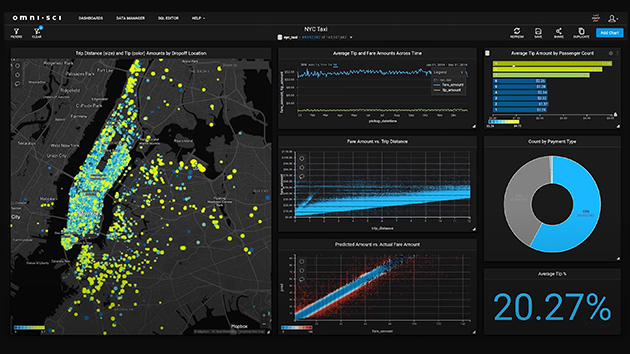

数据科学家需要能够分析和可视化庞大的数据集,并将其转化为宝贵见解。但是,由于数据集分散在多台服务器上,横向扩展解决方案往往会陷入困境。

搭载 A30 的加速服务器可以提供必需的计算能力,并能利用大容量 HBM2 显存、933 GB/s 的显存带宽和通过 NVLink 实现的可扩展性妥善处理这些工作负载。通过结合 InfiniBand、NVIDIA Magnum IO 和 RAPIDS™ 开源库套件(包括 RAPIDS Accelerator for Apache Spark),NVIDIA 数据中心平台能够加速这些大型工作负载,并实现出色的性能和效率水平。

A30 结合 MIG 技术可以更大限度地提高 GPU 加速的基础设施的利用率。借助 MIG,A30 GPU 可划分为多达 4 个独立实例,让多个用户都能使用 GPU 加速功能。

MIG 与 Kubernetes、容器和基于服务器虚拟化平台的服务器虚拟化配合使用。MIG 可让基础设施管理者为每项作业提供大小合适的 GPU,同时确保 QoS,从而扩大加速计算资源的影响范围,以覆盖每位用户。

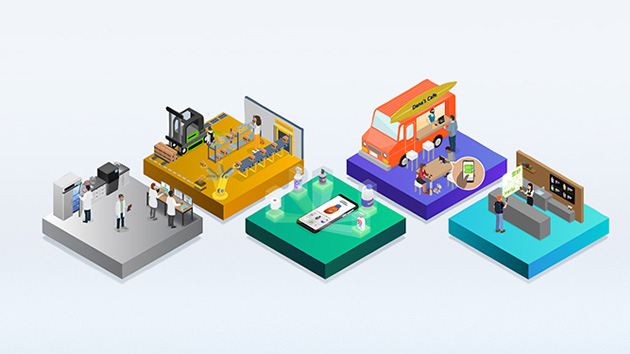

NVIDIA AI Enterprise 是一套端到端云原生 AI 和数据分析软件,经认证可在基于服务器虚拟化平台的虚拟基础设施(带有 VMware vSphere)中的 A30 上运行。这允许在混合云环境中管理和扩展 AI 工作负载。

搭载 NVIDIA A30 的 NVIDIA-Certified Systems™ 将计算加速功能与高速、安全的 NVIDIA 网络整合到 NVIDIA 的 OEM 合作伙伴构建并销售的企业数据中心服务器中。利用此计划,客户可以在单个高性能、经济高效且可扩展的基础设施上识别、获取和部署系统,以运行 NVIDIA NGC (NVIDIA GPU CLOUD) 目录中的传统和多样化的现代 AI 应用程序。

| FP64 | 5.2 teraFLOPS |

| FP64 Tensor Core | 10.3 teraFLOPS |

| FP32 | 10.3 teraFLOPS |

| TF32 Tensor Core | 82 teraFLOPS | 165 teraFLOPS* |

| BFLOAT16 Tensor Core | 165 teraFLOPS | 330 teraFLOPS* |

| FP16 Tensor Core | 165 teraFLOPS | 330 teraFLOPS* |

| INT8 Tensor Core | 330 TOPS | 661 TOPS* |

| INT4 Tensor Core | 661 TOPS | 1321 TOPS* |

| 媒体引擎 | 1 个光流加速器 (OFA) 1 个 JPEG 解码器 (NVJPEG) 4 个视频解码器 (NVDEC) |

| GPU 显存 | 24GB HBM2 |

| GPU 显存带宽 | 933GB/s |

| 互联 | PCIe Gen4: 64GB/s 第三代 NVLINK:200 GB/s** |

| 外形规格 | 双插槽、全高、全长 (FHFL) |

| 最大热设计功耗 (TDP) | 165W |

| 多实例 GPU (MIG) | 4 个 GPU 实例,每个 6 GB 2 个 GPU 实例,每个 12GB each 1 个 GPU 实例,24 GB |

| 虚拟 GPU (vGPU) 软件支持 | 适用于 VMware 的 NVIDIA AI Enterprise NVIDIA 虚拟计算服务器 |

* 采用稀疏技术

** NVLink 桥接器可连接多达 2 个 GPU